返回《在阿里云中搭建大数据实验环境》首页

提示:本教程是一个系列文章,请务必按照本教程首页中给出的各个步骤列表,按照先后顺序一步步进行操作,本博客假设你已经顺利完成了之前的操作步骤。

在阿里云ECS的Ubuntu系统中安装Hadoop,和在本地电脑安装Hadoop,基本相似,但是,也有略微差别,必须正确配置,否则,会导致无法顺利启动。安装Hadoop之前,请确保已经根据前面的博客《在ECS实例的Ubuntu系统中安装Java》完成了Java的安装。

我们已经把Hadoop的安装包hadoop-2.7.1.tar.gz放在了百度云盘(建议选择2.7.1版本,确保和本教程的其他大数据软件在版本上能够兼容,选择其他Hadoop版本,可能导致其他软件会运行出错),可以点击这里到百度云盘下载Hadoop安装包(提取码:gx0b)。把压缩格式的文件hadoop-2.7.1.tar.gz下载到本地电脑,然后,参考之前的FTP使用指南,在本地电脑中,使用FTP软件,使用用户名linziyu连接阿里云ECS实例,把hadoop-2.7.1.tar.gz这个压缩格式文件上传到远程的阿里云ECS实例的Ubuntu系统中,可以上传到Ubuntu系统的“/home/linziyu/Downloads/”目录下。

根据本教程前面博客介绍的方法,采用用户名linziyu,使用Putty连接ECS中的Ubuntu系统,进入命令行界面,或者也可以使用VNCViewer连接ECS中的Ubuntu系统打开“终端”进入命令行界面。总之,一定要进入命令行界面,这样可以在里面输入Shell命令,来安装Java。

假设现在已经进入命令行界面中,当前登录用户名是linziyu。

更新apt

用linziyu 用户登录后,我们先更新一下 apt,后续我们使用 apt 安装软件,如果没更新可能有一些软件安装不了。在命令行界面中执行如下命令:

sudo apt-get update

安装SSH、配置SSH无密码登陆

Hadoop集群、单节点模式都需要用到 SSH 登陆(类似于远程登陆,你可以登录某台 Linux 主机,并且在上面运行命令),Ubuntu 默认已安装了 SSH client,此外还需要安装 SSH server:

sudo apt-get install openssh-server

安装后,可以使用如下命令登陆本机:

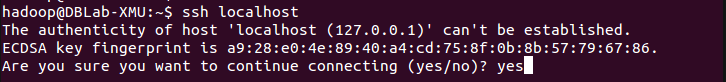

ssh localhost

此时会有如下提示(SSH首次登陆提示),输入 yes 。然后按提示输入密码 hadoop,这样就登陆到本机了。

但这样登陆是需要每次输入密码的,我们需要配置成SSH无密码登陆比较方便。

首先退出刚才的 ssh,就回到了我们原先的终端窗口,然后利用 ssh-keygen 生成密钥,并将密钥加入到授权中:

exit # 退出刚才的 ssh localhost

cd ~/.ssh/ # 若没有该目录,请先执行一次ssh localhost

ssh-keygen -t rsa # 会有提示,都按回车就可以

cat ./id_rsa.pub >> ./authorized_keys # 加入授权

此时再用 ssh localhost 命令,无需输入密码就可以直接登陆了,屏幕上会显示如下信息:

linziyu@iZbp11gznj7n38xkztu64dZ:~$ ssh localhost

Welcome to Ubuntu 14.04.5 LTS (GNU/Linux 4.4.0-93-generic x86_64)

* Documentation: https://help.ubuntu.com/

23 packages can be updated.

9 updates are security updates.

New release '16.04.4 LTS' available.

Run 'do-release-upgrade' to upgrade to it.

Your Hardware Enablement Stack (HWE) is supported until April 2019.

Welcome to Alibaba Cloud Elastic Compute Service !

Last login: Fri Apr 6 10:51:13 2018 from 118.12.231.185

安装Java

安装Hadoop之前,请确保已经根据前面的博客《在ECS实例的Ubuntu系统中安装Java》完成了Java的安装。

修改hostname配置文件

sudo vim /etc/hosts

打开这个配置文件以后,在里面增加一行“192.168.1.106 iZbp11gznj7n38xkztu64dZ”,增加以后的效果如下:

192.168.1.106 iZbp11gznj7n38xkztu64dZ

127.0.0.1 localhost

# The following lines are desirable for IPv6 capable hosts

::1 localhost ip6-localhost ip6-loopback

ff02::1 ip6-allnodes

ff02::2 ip6-allrouters

增加的一行“192.168.1.106 iZbp11gznj7n38xkztu64dZ”中,192.168.1.106是阿里云ECS实例的私有IP地址,iZbp11gznj7n38xkztu64dZ是ECS实例中的Ubuntu系统的主机名。

安装 Hadoop

我们选择将 Hadoop 安装至 /usr/local/ 中,用linziyu用户登录Ubuntu系统后,在命令行终端中,执行如下命令:

cd ~

sudo tar -zxf ~/Downloads/hadoop-2.7.1.tar.gz -C /usr/local # 解压到/usr/local中

cd /usr/local/

sudo mv ./hadoop-2.7.1/ ./hadoop # 将文件夹名改为hadoop

sudo chown -R linziyu:linziyu ./hadoop # 修改文件权限

Hadoop 解压后即可使用。输入如下命令来检查 Hadoop 是否可用,成功则会显示 Hadoop 版本信息:

cd /usr/local/hadoop

./bin/hadoop version

Hadoop伪分布式配置

Hadoop 可以在单节点上以伪分布式的方式运行,Hadoop 进程以分离的 Java 进程来运行,节点既作为 NameNode 也作为 DataNode,同时,读取的是 HDFS 中的文件。

Hadoop 的配置文件位于 /usr/local/hadoop/etc/hadoop/ 中,伪分布式需要修改2个配置文件 core-site.xml 和 hdfs-site.xml 。Hadoop的配置文件是 xml 格式,每个配置以声明 property 的 name 和 value 的方式来实现。

修改配置文件 core-site.xml (使用vim编辑器: vim /usr/local/hadoop/etc/hadoop/core-site.xml),该文件原来的内容如下:

<configuration>

</configuration>

请把该文件修改为下面配置:

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://192.168.1.106:9000</value>

</property>

</configuration>

注意,在上面这个core-site.xml文件中,“hdfs://192.168.1.106:9000”的IP地址是你的阿里云ECS实例的“私网IP地址”192.168.1.106,不是公网IP地址。你的私网IP地址可能不是这个,可以登录阿里云控制台,查询自己的ECS实例的私网IP地址。

同样的,修改配置文件 hdfs-site.xml:

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/data</value>

</property>

</configuration>

Hadoop配置文件说明:

Hadoop 的运行方式是由配置文件决定的(运行 Hadoop 时会读取配置文件),因此如果需要从伪分布式模式切换回非分布式模式,需要删除 core-site.xml 中的配置项。

此外,伪分布式虽然只需要配置 fs.defaultFS 和 dfs.replication 就可以运行(官方教程如此),不过若没有配置 hadoop.tmp.dir 参数,则默认使用的临时目录为 /tmp/hadoo-hadoop,而这个目录在重启时有可能被系统清理掉,导致必须重新执行 format 才行。所以我们进行了设置,同时也指定 dfs.namenode.name.dir 和 dfs.datanode.data.dir,否则在接下来的步骤中可能会出错。

配置完成后,执行 NameNode 的格式化:

cd /usr/local/hadoop

./bin/hdfs namenode -format

成功的话,会看到 "successfully formatted" 和 "Exitting with status 0" 的提示,若为 "Exitting with status 1" 则是出错。

如果在这一步时提示 Error: JAVA_HOME is not set and could not be found. 的错误,则说明之前设置 JAVA_HOME 环境变量那边就没设置好,请按教程先设置好 JAVA_HOME 变量,否则后面的过程都是进行不下去的。如果已经按照前面教程在.bashrc文件中设置了JAVA_HOME,还是出现 Error: JAVA_HOME is not set and could not be found. 的错误,那么,请到hadoop的安装目录修改配置文件“/usr/local/hadoop/etc/hadoop/hadoop-env.sh”,在里面找到“export JAVA_HOME=${JAVA_HOME}”这行,然后,把它修改成JAVA安装路径的具体地址,比如,“export JAVA_HOME=/usr/lib/jvm/default-java”,然后,再次启动Hadoop。

接着开启 NameNode 和 DataNode 守护进程。

cd /usr/local/hadoop

./sbin/start-dfs.sh #start-dfs.sh是个完整的可执行文件,中间没有空格

若出现SSH提示,输入yes即可,启动过程会显示如下形式的屏幕信息:

linziyu@iZbp11gznj7n38xkztu64dZ:/usr/local/hadoop$ ./sbin/start-dfs.sh

Starting namenodes on [iZbp11gznj7n38xkztu64dZ]

iZbp11gznj7n38xkztu64dZ: starting namenode, logging to /usr/local/hadoop/logs/hadoop-linziyu-namenode-iZbp11gznj7n38xkztu64dZ.out

localhost: starting datanode, logging to /usr/local/hadoop/logs/hadoop-linziyu-datanode-iZbp11gznj7n38xkztu64dZ.out

Starting secondary namenodes [0.0.0.0]

0.0.0.0: starting secondarynamenode, logging to /usr/local/hadoop/logs/hadoop-linziyu-secondarynamenode-iZbp11gznj7n38xkztu64dZ.out

启动时可能会出现如下 WARN 提示:WARN util.NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable WARN 提示可以忽略,并不会影响正常使用。

启动以后,使用jps命令查询进程,如果显示如下四个进程,则说明Hadoop启动成功:

linziyu@iZbp11gznj7n38xkztu64dZ:/usr/local/hadoop$ jps

21923 Jps

21592 DataNode

21417 NameNode

21806 SecondaryNameNode

如果要停止Hadoop,可以使用如下命令:

cd /usr/local/hadoop

./sbin/stop-dfs.sh